|

查看: 757|回复: 1

|

AI deepfake沦为“杀猪盘”,MUDA美女身份被盗用行骗

[复制链接]

[复制链接]

|

|

|

(新加坡15日讯) 在马来西亚去年的6州选举中,被称为最美候选人的大马民主联合阵线(MUDA)党员林慧娴,过去两三年常常收到陌生男子的大量骚扰和威胁短信,不是要她以身相许,就是要她立即还钱。

28岁的林慧娴是一名环保人士,也是活跃的Instagram用户,有逾10万追随者,频频在社群媒体上分享生活动态,不料却给她带来困扰,相信有诈骗集团盗用她的个人资讯行骗。

林慧娴接受《联合早报》访问时透露,最近这种情况越来越严重,她每天会收到10到20条威胁短信,有些甚至说要飞来马来西亚找她和家人算账。

为了自证清白,她1月31日向警方报案,在社媒公开报案信,也数次在社媒发文澄清,但情况没有改善。

1月31日,林慧娴到吉隆坡白沙罗警察局报案,表示个人资料被不法份子严重盗用,受害者来自新加坡、美国、加拿大、土耳其和哈萨克等国。

她称,曾多次向Instagram投诉身分被假帐号盗用,但未受到重视。

1月31日,林慧娴到吉隆坡白沙罗警察局报案,表示个人资料被不法份子严重盗用,受害者来自新加坡、美国、加拿大、土耳其和哈萨克等国。

Instagram母公司Meta发言人告诉《联合早报》,平台已审查相关帐号并采取了行动,但“不良行为者会不断改变策略逃避监测,这也意味著没有一种工具可以成为灵丹妙药”。

记者根据林慧娴提供的短讯截图,联系上几名声称被林慧娴诈骗的受害男子。

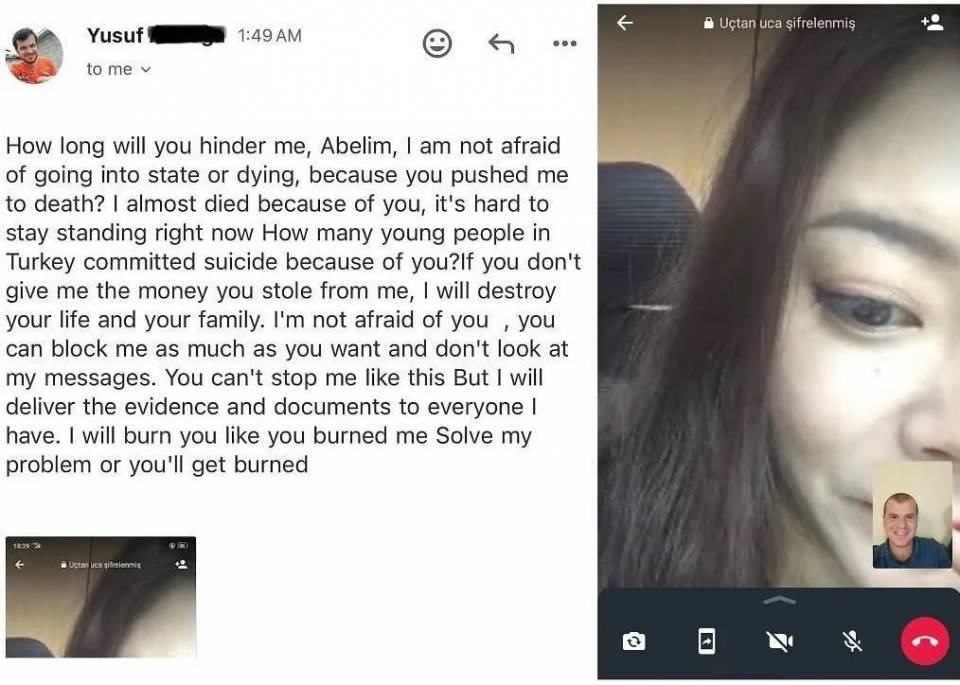

土耳其男子尤索夫(29岁)受访时说,2022年12月,一名自称“Li Chu Xue”的女子以误发短讯的方式与他建立联系,然后对他发动甜蜜攻势,他与对方展开长达一年的网路交友。

他透露,期间,对方多次以“要存更多钱才能结婚”为由,游说他进行加密货币交易,最后他被骗了9万1000美元(约42万7927令吉50仙)。

尤索夫坚信“Li Chu Xue”就是林慧娴。

“我与她视频通话4次,画面高清、声音清楚,还有数不清的照片和视频,她的报警声明证明不了什么。”

林慧娴反驳称,自己不曾与尤索夫联系,更没有欺骗对方的钱财。

另两名土耳其男子奥兹德米尔(45岁)和不愿透露全名的塞尔坎(S32岁)告诉《联合早报》,他们被“Suna”和“Dora”骗了很多钱,他们也相信“Suna”和“Dora”就是林慧娴。

2023年12月6日,自称“Dora”的诈骗犯以误发短讯的手法联系上塞尔坎,随后以“叔叔能内线交易”说服塞尔坎投资,他最终被骗8000美元(约3万7620令吉)。

他们透露,联系其他受害者后,估计有至少27人。他们已组织起来,向土耳其当局报案,案件现已进入调查阶段。

加拿大男子阿尔丰斯阮(57岁)受访时透露,当加密货币交易平台第三次拒绝让他提款后,他有不详的预感,所以要求和网聊了3周的女密友“Olivia Wong”视讯通话。

“我本来就从事电脑相关行业,视讯通话开始没多久,我就知道钱被骗走了。她和真正的林慧娴长得有点不像。”

阿尔丰斯意识到自己可能陷入“杀猪盘”骗局后,录下与诈骗犯的对话过程。

为证明心中猜想,他要求与女密友“Olivia Wong”视讯通话,发现影片与照片有差异,意识到自己被骗。

3名土耳其受访者都不相信人工智慧(AI)深伪(deepfake)技术能制作出高清影片。

奥兹德米尔说,他在与对方视讯通话的两分钟里,甚至看到她脸上的小痘痘。

生成式AI专家许冰受访时说,目前的深伪技术可以让诈骗集团根据需要,制作出细节真实的伪造影片。

“当前的深伪技术完全可以让诈骗团伙根据需要,制作出带有青春痘、雀斑等脸部 细节的虚假内容。”

应记者要求,许冰分析了阿尔丰斯录下的影片。他指出,常见相机拍摄的画面是长方形的,但影片是生成式模型预设的正方形,这显然是有问题的。

“由于对方很少出现肢体动作,不排除是使用了最初级的换脸技术。”

中国科学技术大学网路空间安全学院副教授周文柏分析阿尔丰斯的影片截图后说,影片中的人脸缺少细节,纹理过于平滑,光影变化不足,脸部不时会出现明显抖动。这是用了效果一般的深伪模型生成的典型画面。

周文柏是深度伪造攻防和AI安全领域的专家,他建议人们须时时保持警惕,才能避免被深伪内容诏骗。

他建议,人们要求视讯通话的对象转身、遮挡脸部、挤捏鼻子等,来试著辨别影片中人的真伪。

不过,他强调,重要的不是找出明确可用的鉴别方法,而是提高警觉心。 若没有保持警惕的习惯,也就不会想到采用那些鉴别办法。

尽管专家建议,人们透过观察影片中人是否符合现实世界的物理规律,例如观察人物轮廓、脸部协调感、眨眼次数等,来辨别真伪,但美国人工智慧公司OpenAI今年2月推出的文字生成视频模型Sora,能够更准确地生成符合现实世界物理原理的逼真视频,再次动摇了用眼睛辨别真假的可靠性。

让情况雪上加霜的是,本应与生成技术一同迭代更新的鉴别技术,陷入了发展瓶颈。

新加坡国立大学电脑学院资讯系统与分析学教授韩晸弼受访时说,现有技术如影像和文字的水印监测工具等,存在一定的操作缺陷,准确率并不高,所以自动监测系统 常会出现大量“假阳性”。

“在任何时候,带有恶意的人都可能占有优势,因为研究员必须创建更好的深伪训练数据,才能开发新的检测技术。这样一来,许多平台只能聘用专业审查员鉴别真伪,但这种方法的成本很高,社媒等在线平台可能无法承担。 ”

英国网路验证公司Sumsub今年初发表的《2023年身分诈欺报告》指出,2022年至2023年间,亚太区的深伪事件增加了1530%。 由此可见,深伪正成为诈欺集团有力的犯罪工具。

今年2月,AI教父本吉欧与400多名专家和业界主管签署公开信,指深伪技术或危害社会,并呼吁加强对深伪技术的监管。

当AI深伪诈骗颠覆“眼见为实”,专家建议,人们只能时刻保持警惕,做到不轻信、不透露、不转账,并与亲友预设认证密码,以在关键时刻验明“正身” 。

|

-

|

|

|

|

|

|

|

|

|

|

|

发表于 15-3-2024 03:59 PM

|

显示全部楼层

发表于 15-3-2024 03:59 PM

|

显示全部楼层

目前的AI换脸的问题很多,所以之前的AA视频一出,几乎可以确认是真人上演

可惜当时AA还在公正党,希盟的支持者只相信自己人不相信事实

|

|

|

|

|

|

|

|

|

|

| |

本周最热论坛帖子 本周最热论坛帖子

|